|

같은 기간 무기 판매와 관련된 게시물은 약 67만건 처리됐으며, 이중 69.9%에 선제적인 조치가 이뤄졌다.

기술적으로 대응한 덕분이다. 페이스북은 2018년 여름부터 마약이나 무기 같은 규제 상품을 판매하려는 사람을 찾기 위해 AI를 쓰기 시작했다.

예전에는 주로 기존에 제거한 콘텐츠와 관련된 프로필·페이지·그룹·해시태그·계정 등에 대한 조사, 마약판매와 관련된 수백 개의 은어·비속어에 대한 차단과 필터링, 실생활에서 사람들이 마약을 가르킬 때 쓰는 새로운 표현 등을 포함해 나쁜 사람들이 어떤 방식으로 일하는지를 배우기 위한 전문가들과의 협력 등을 통해 마약 거래를 차단했다.

|

2019년 1분기, 페이스북은 400만건의 혐오발언 게시물을 삭제했다.

지우기만 하는 걸까..복구도 활발

페이스북이 의심 콘텐츠를 무조건 삭제하기만 하는 것은 아니다.

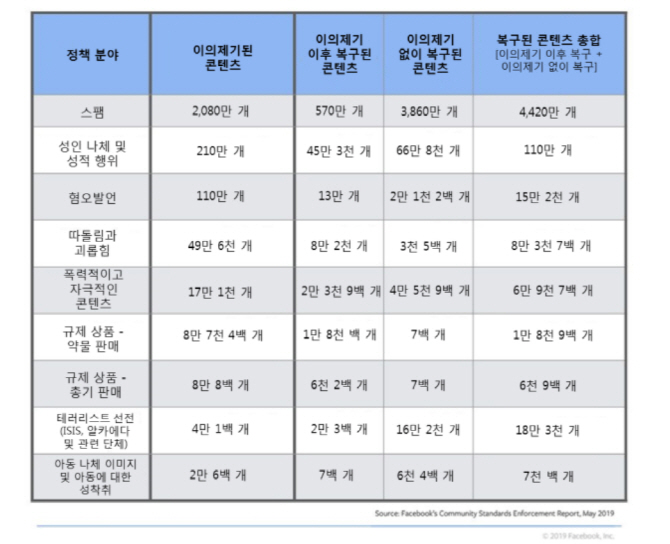

이 보고서에서는 이용자의 이의제기를 통해 복구한 콘텐츠 뿐아니라, 이의제기가 없었더라도 자체 실수를 발견하고 복구한 콘텐츠의 수치도 함께 공개했다.

페이스북은 ▲동일한 콘텐츠를 포함한 복수의 포스트를 관리하다 실수가 생긴 경우 한 개 이의에도 동일 콘텐츠 모두 복구 ▲콘텐츠 리뷰 과정에서 실수가 있었을 경우 이의제기와 상관없이 복구 ▲스팸으로 의심되는 링크를 포함한 게시물을 삭제한 경우, 해당 링크가 스팸이 아닌 것으로 판명되면 관련 게시물을 복구한다.

|

![[포토] '금융권 공감의 장' 인사말하는 오화경 회장](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112600932t.jpg)

![[포토]경북 국립의대 신설 촉구, '참석자들에게 인사하는 한동훈'](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112600846t.jpg)

![[포토]손태승 전 회장, 영장실질심사 출석](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112600794t.jpg)

![[포토]내년에 또보자 가을](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112600715t.jpg)

![[포토]민주당 민생연석회의 참석하는 이재명 대표](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112600655t.jpg)

![[포토] '소상공인 힘보탬 프로젝트' 발표](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112600583t.jpg)

![[포토]정부, 국무회의에서 세번째 `김여사 특검법` 거부권 건의 의결](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112600579t.jpg)

![[포토] 이즈나 데뷔](https://spnimage.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112500181t.jpg)

![[포토]첫 싱글 '라스트 벨'로 돌아온 TWS](https://spnimage.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112500118t.jpg)

![[포토] 의원들과 인사나누는 이재명 대표](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112500985t.jpg)