|

국내에서 1985년부터 1987년까지 인기리에 방영된 미국 드라마 ‘전격Z작전: Knight rader’ 주인공의 대사 중 한 대목입니다. 드라마에 등장하는 키트는 인공지능이 탑재된 자율주행자동차인데요. 주인공은 위기 상황에 처하거나 도움이 필요할 때 손목시계에 탑재된 호출기를 통해 키드를 불러서 문제를 해결하고는 했습니다.

키트는 주인공의 기분에 맞춰 음악을 틀어주거나 유머스러운 농담까지 던지면서 등 운전자와 교감하는 모습을 보여줬는데요. 당시로서는 허구적인 드라마에서만 가능한 일일뿐 키트는 먼 미래의 일로만 여겨졌습니다.

하지만 20여 년의 시간이 흐른 지금 키트는 허구가 아닌 현실로 다가오고 있습니다. 바로 인공지능(AI) 기술의 발달 때문인데요. AI 기술이 자동차에 적용되면서 진화를 거듭하고 있습니다.

현대차그룹, 감정인식 차량 제어 기술 앞장

운전자와 차량 교감의 핵심 기술인 감정인식 차량 제어(Emotion Adaptive Vehicle Control, EAVC)시장의 전망은 밝은데요. 감정 인식보다 상위 개념인 운전자 상태 모니터링(Driver Monitoring System, DMS) 시장 전망으로 추정할 수 있습니다. 글로벌리서치기업 마켓츠앤마켓츠(MarketsandMakets)와 현대자동차그룹에 따르면 운전자 상태 모니터링시장 규모는 올해 10억6000만달러(약 1조2400억원) 수준으로 추정됩니다. 운전자 상태 모니터링 시장 규모는 2025년에 16억4000만달러(약 1조9100억원)로 전망됩니다. 연평균 성장률이 12%에 이르는 셈이죠.

|

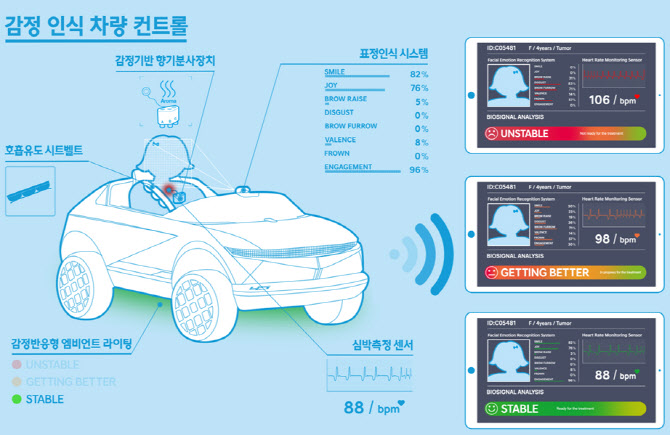

현대자동차는 작년 12월부터 감정인식 차량 제어 기술이 적용된 키즈 모빌리티 리틀빅 이모션(Little Big e-Motion, 이모션)을 개발해 어린이 환자 치료에 시범 운용하고 있습니다. 이모션은 미래 자율주행시대에 필수적인 자동차와 운전자의 교감을 가능하게 하는 감정 인식 차량 컨트롤 기술을 기반으로 만들어졌습니다.

감정인식 차량 제어 기술은 현대차그룹 연구개발본부와 미국 메사추세츠 공과대학(MIT) 미디어랩이 산학협력 중인 연구 과제이기도 한데요. 입원 중인 어린이 환자들이 병실에서 진료실까지 짧은 이동거리가 세상에서 제일 두렵고 무서운 긴 여정으로 느낀다는 점에 착안해 치료 과정에서 발생하는 극심한 스트레스를 줄이기 위해 적용하게 됐습니다.

|

표정인식시스템은 운전석 앞에 달린 카메라가 어린이의 얼굴 표정을 읽고 감정을 파악합니다. 에어 포켓이 적용된 호흡 유도 시트벨트는 몸을 감싸 안아 어린이가 심리적 안정감을 느낄 수 있도록 도와주는데요. 시트벨트에 장착된 심박측정센서를 통해 심박수와 호흡을 측정합니다. 이렇게 측정된 어린이 환자의 감정과 신체 상태 정보는 의료진에 전송됨과 동시에 다양한 콘텐츠 형태로 출력돼 이동하는 순간이 즐거운 놀이 과정이 될 수 있도록 돕습니다.

차체 하부에 적용된 감정반응형 엠비언트 라이팅은 감정 인식 차량 제어 기술과 연동해 컬러를 변경하면서 주변 의료진과 환자 보호자에게 어린이의 감정 상태를 알려줍니다. 빨강색은 두려움을 많이 느끼고 있는 상태입니다. 노랑색은 두려움이 다소 줄어든 상태, 초록색은 진료받을 준비가 된 상태를 의미합니다. 차량 전면에 장착된 디스플레이 장치에는 감정인식 차량 제어 기술과 연동된 다양한 애니메이션과 음악이 나오는데요. 감정기반 향기 분사 장치에서는 심호흡을 도와주는 호흡 유도 시트벨트의 팽창 주기에 따라 달콤한 사탕 향기를 분사해 어린이의 기분 전환을 돕습니다. 또 진료를 받기 위해 이동하는 마지막 과정에서 비눗방울이 분사됩니다.

기아, 2019 CES서 리드시스템 첫 공개

기아는 실시간 감정반응 차량제어 시스템(Real-time Emotion Adaptive Driving, 리드(READ) 시스템)을 개발 중입니다. 기아는 2019년 국제 전자제품 박람회(CES)에서 리드시스템을 처음 공개했는데요. 리드시스템은 자율주행 기술이 보편화된 이후 등장하게 될 감성 주행(Emotive Driving) 시대의 핵심 기술 콘셉트로 자동차와 운전자가 교감하는 혁신 기술을 기반으로 합니다. 운전자의 생체 신호를 자동차가 인식해 차량 내의 오감 요소를 통합 제어함으로써 실시간으로 운전자의 감정과 상황에 맞게 차량의 실내 공간을 최적화하는 기술인데요.

리드시스템은 AI의 머신 러닝 기술과 고도화된 카메라와 각종 센서, 차량 제어 기술을 결합해 탄생시켰습니다. AI머신 러닝을 기반으로 가속과 △감속 △진동 △소음 등 다양한 주행환경과 실내·외 환경 조건 속에서 운전자가 반응하는 생체 정보와 감정 상태를 차량이 학습한 뒤 차량 내 카메라와 센서를 통해 운전자의 감정 상태와 생체 정보를 실시간으로 추출하는데요. 해당 상황에 맞는 음악과 △온도 △조명 △진동 △향기 등 최적화된 실내 환경을 운전자에게 능동적으로 제공합니다.

리드시스템에 적용된 가상 터치식 제스처 제어 기술(Virtual Touch)은 3D카메라를 통해 탑승자가 가리키는 손끝을 차량이 인식해 탑승자가 별도의 버튼 조작이나 스크린을 터치하지 않는 것이 특징인데요. 운전자의 제스처를 통해 조명과 온도, 각종 엔터테인먼트 시스템을 제어할 수 있도록 하는 원거리 제스처 제어 기술입니다.

리드시스템 모듈은 총 4가지로 구성됐는데요. △전체적인 시스템이 어떻게 구현되는 지를 확인할 수 있는 리드칵핏 △1인용 모듈인 리드미 △2인용 모듈인 리드나우 △4인용 모듈인 리드모션입니다. 리드미는 얼굴 표정 인식 기술을 이용해 운전자의 감정 상태를 분석합니다. 또 실시간 감정 상태에 따라 음악 감응 진동시트 기술 등과 연계해 운전자의 상황에 가장 적합한 맞춤형 음악과 진동, 향기를 제공합니다.

리드나우는 얼굴 표정 인식 기술과 음악 감응 진동시트 기술, 가성 터치식 제스처 제어 기술도 적용했습니다. 리드모션은 자율주행 시대가 제공하게 될 이동식 작업 공간을 구현한 것이 특징입니다. 탑승객들은 가상 터치식 제스처 제어 기술을 이용해 스케줄과 회의록, 이메일 열람 등의 업무를 체험할 수 있고 실시간 컨퍼런스콜도 직접 참여할 수 있습니다. 기아는 2019년 뉴욕 국제 오토쇼에서 공개한 크로스오버유틸리티차량(CUV) 전기 콘셉트카 하바니로(HabaNiro)에 리드시스템을 적용했습니다. 하지만 추후 양산될 차량에도 리드시스템을 적용할지는 미지수입니다.

![[포토]스케이트 타는 시민들로 북적](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122200317t.jpg)

![[포토]기름값 10주째 올라…전국 휘발유 평균 1652.2원](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122200258t.jpg)

![[포토]크리스마스 분위기](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122200248t.jpg)

![[포토]'서울광장 스케이트장 좋아요'](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122000768t.jpg)

![[포토] 나인퍼레이드 캠페인](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122000496t.jpg)

![[포토]더불어민주당 최고위원회의 개최](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122000232t.jpg)

![[포토]영화 속 배경에서 찰칵](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24121901369t.jpg)

![[포토] 아수라장된 기자회견장](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24121901115t.jpg)

![[포토]다양한 식음료가 한 자리에, '컬리 푸드페스타 2024'](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24121900958t.jpg)

![[포토]안소현-김성태 본부장,취약계증 후원금 전달식 진행](https://spnimage.edaily.co.kr/images/vision/files/NP/S/2024/12/PS24121400036h.jpg)