|

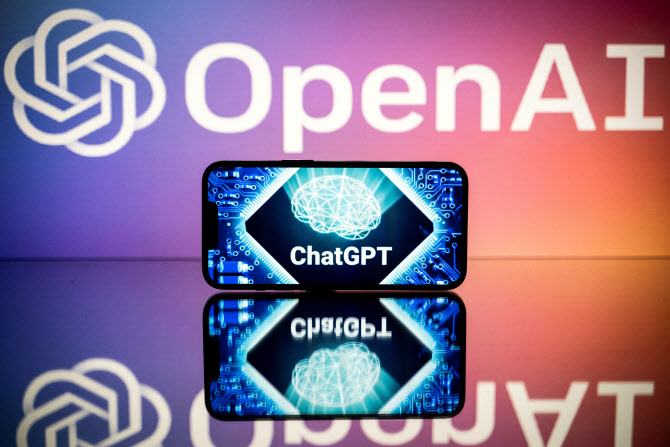

11일(현지시간) 월스트리트저널(WSJ) 등에 따르면 미 상무부 산하 국가통신정보청(NTIA)는 AI 안전 규칙 제정을 마련하기 위한 60일간 공개 의견 수렴에 나섰다. AI의 윤리성·신뢰성을 확보하기 위한 제도적 장치를 마련하기 위한 첫걸음으로 해석된다. NICA는 수렴된 의견을 바탕으로 백악관과 의회에 정책 권고안을 제출할 예정이다.

공개 의견 수렴에 나선 것은 최근 AI 산업이 급성장하자 AI가 부정확한 정보를 제공하거나 잘못된 방향으로 이용자를 호도할 수 있다는 우려도 커지고 있기 때문이다.

WSJ은 NTIA가 AI의 위험성을 사전에 차단하기 위해 상품·서비스 출시에 앞서 안전성 인증 절차를 밟게 하는 방안도 검토 중이라고 보도했다. 미 정부에 납품하는 AI 상품·서비스에 윤리성·신뢰성 검수를 의무화하거나 AI 알고리즘 내에서 소수자 등에 대한 차별 요소를 발견하는 사람에게 포상금을 지급하는 방안도 거론된다.

최근 미국 정부는 AI의 안전성에 대한 우려를 드러내고 있다. 조 바이든 미국 대통령은 지난주 백악관 과학기술자문위원회 회의에서 AI가 사회와 경제·국가안보에 미칠 잠재적 위험을 거론하며 “기술 회사는 제품을 공개하기 전에 그것이 안전한지 확인할 책임이 있다”고 말한 바 있다. 바이든 행정부는 지난해엔 AI 개발자·이용자를 위한 가이드라인인 ‘AI 권리장전’을 만들어 AI가 성·인종차별 방지, 사생활 보호장치 등을 갖춰야 한다고 권고했다.

이탈리아 데이터보호청도 AI 챗봇인 챗GPT가 개인정보 보호 기준을 충족하지 못한다며 지난달 접속을 차단했다. 프랑스와 아일랜드, 캐나다 당국도 유사한 조치를 검토하고 있다.

AI 기업도 규제 필요성을 인정하고 있다. 챗GPT 개발사인 오픈AI는 “강력한 AI 시스템은 엄격한 안전평가를 받아야 한다”며 “최선의 형태로 규제가 마련될 수 있도록 정부와 적극적으로 협력하고 있다”고 밝혔다. 이는 불안정한 AI로 인한 사고를 미연에 방지, 사업의 지속 가능성을 확보하기 위한 것으로 해석된다.

![[포토]이보미,오랜만에 쉽지않네](https://spnimage.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24110900387t.jpg)

![[포토] 이대한 '오늘 홀인원 한 볼입니다'](https://spnimage.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24110900174t.jpg)

![[포토]박현경,반가운 시선](https://spnimage.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24110900018t.jpg)

![[포토] 가축분 고체연료 협약 인사말하는 김준동 남부발전 사장](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24110801640t.jpg)

![[포토] 장유빈 '정교함까지 장착한 장타자'](https://spnimage.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24110800230t.jpg)

![[포토]예결위 전체회의, '답변하는 한덕수 국무총리'](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24110801228t.jpg)

![[포토]난방용품 바라보는 소비자](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24110701539t.jpg)

![[포토]트럼프 대툥령 당선에 환율 1400대 돌입 임박](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24110701513t.jpg)

![[포토] 장동규 '강한 임팩트를 구사'](https://spnimage.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24110700185t.jpg)

!['낭만의 차' 픽업트럭의 시대…'新시장' 도전장 낸 차는[이車어때]](https://image.edaily.co.kr/images/vision/files/NP/S/2024/11/PS24110900153h.jpg)

![[포토]첫 홀 출발하는 임희정](https://spnimage.edaily.co.kr/images/vision/files/NP/S/2024/11/PS24110900651h.jpg)

![평생 달리다 늙으면 굶어죽는 경주퇴역마…“경찰기마대도 학대 당해”[댕냥구조대]](https://image.edaily.co.kr/images/vision/files/NP/S/2024/11/PS24110900339b.jpg)