|

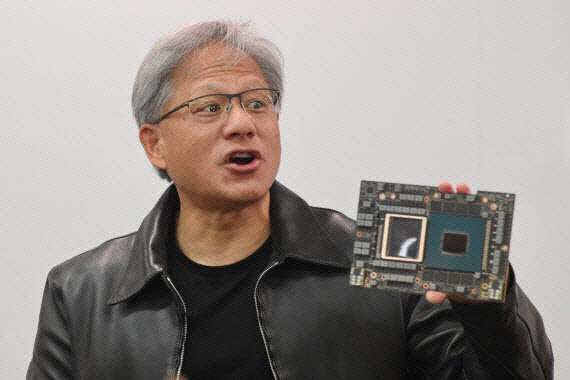

H200에는 무려 141GB의 차세대 메모리 ‘HBM3’가 탑재돼 있다. 기존 H100의 메모리는 80GB이다. 고대역폭 메모리인 HBM은 여러 개의 D램을 수직으로 연결해 데이터 처리 속도를 끌어올린 고성능 제품이다. 데이터가 다니는 통로가 넓어진 만큼 속도가 빨라진다. AI모델을 사용한 텍스트, 이미지 등 생성능력과 추론 능력이 기존 H100보다 약 60~90% 향상됐다는 게 엔비디아의 설명이다.

엔비디아 측은 “메타의 LLM ‘라마2’를 대상으로 테스트해 본 결과 H200가 기존의 H100에 비해 처리 속도가 최대 2배가량 빠른 것으로 확인됐다”고 설명했다.

아울러 엔비디아는 전력 사용량을 최소화 시킨 암(ARM)기반의 엔비디아 그레이스호퍼 슈퍼칩(GH200)과 컴퓨팅 플랫폼인 HGX와 호환이 가능하도록 했다. GPU 외 중앙처리장치(CPU) 등으로 다양한 포트폴리오 확장에 나서고 있는 엔비디아입장에서는 AI업체에 일체형 서버를 제공하면서 시장 지배력을 키우겠다는 복안이다.

엔비디아는 내년 2분기에 H200 판매에 들어갈 전망이다. 구체적인 가격은 아직 공개되지 않았지만, 현재 H100 칩 1개당 가격이 2만5000달러∼4만달러인 점을 감안하면 이보다 높은 가격으로 출시될 것으로 예상된다.

관건은 엔비디아가 H200칩을 충분히 생산할 수 있을 지 여부다. 엔비디아는 세계 최고 팹리스(반도체 설계회사)인 TSMC를 통해 AI칩을 생산하고 있다. AI가 각광을 받으면서 기존 칩인 H100만 해도 수요 대비 공급이 달리고 있어 충분한 이익을 보지 못하고 있다. 중국의 경우 미국의 반도체 수출 규제로 수출이 막혀 있지만, 중동을 비롯해 전 세계에서 엔비디아의 AI칩 사재기에 나서고 있는 실정이다. 실리콘밸리에서는 H100을 충분히 보유한 유통업체를 찾는 게 핵심 비즈니스가 됐다는 소문이 돌 정도다. 엔비디아는 생산물량 전망에 대해 언급을 하지 않았다.

미국의 IT전문지 ‘더 버지’는 “관건은 기업들이 엔비디아의 차세대칩을 충분히 손에 넣을 수 있을지 여부다”면서 “엔비디아는 아직 이에 대한 해답을 갖고 있지 않을 것 같다”고 분석했다.

![[포토]축사하는 이상원 양형위원장](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112200974t.jpg)

![[포토] 농가희망봉사단, 마을회관 기증품 전달](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112200740t.jpg)

![[포토]축사하는 한덕수 국무총리](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112200598t.jpg)

![[포토]오언석 구청장 '경원선 지하화 추진협의회' 출범식 참석](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112101263t.jpg)

![[포토]지드래곤, 출국](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112101253t.jpg)

![[포토]이력서 작성하는 어르신들](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112101012t.jpg)

![[포토] 전국시도교육감 총회장에서 시위하는 조합원들](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112101008t.jpg)

![[포토]이재명 더불어민주당 대표, 소상공인들과 간담회](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112100813t.jpg)

![[포토]]인사 나누는 이재명 더불어민주당 대표-김동연 경기지사](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/11/PS24112100709t.jpg)

!['드림카'로 즐기는 한밤의 드라이브…강민경의 차는[누구차]](https://image.edaily.co.kr/images/vision/files/NP/S/2024/11/PS24112300115h.jpg)

!["고물가 맞아요?" 돈 쓸어담는 이곳…파이브가이즈의 '비결' [먹어보고서]](https://image.edaily.co.kr/images/vision/files/NP/S/2024/11/PS24112400032b.jpg)

![지연·황재균 재산분할 이혼…함께살던 롯데월드타워 집은? [누구집]](https://image.edaily.co.kr/images/vision/files/NP/S/2024/11/PS24112400039h.jpg)